기본 숙제(필수): Ch.07(07-1) 확인 문제(p.386) 풀고, 설명하기

답: 3번

1000 x 10(특성 x 뉴런 개수) + 10(각 뉴런당 절편) 이므로 총 1010개의 모델 파라미터가 필요하다.

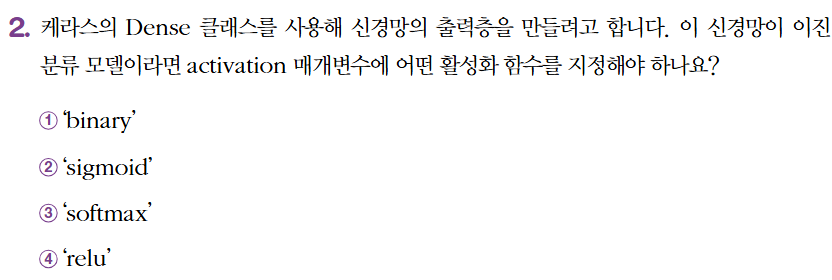

답: 2번

이진 분류의 경우 sigmoid 함수를 활성화 함수로 지정한다.

답: 4번

compile() 메서드에서 손실 함수와 측정 지표 등을 지정한다.

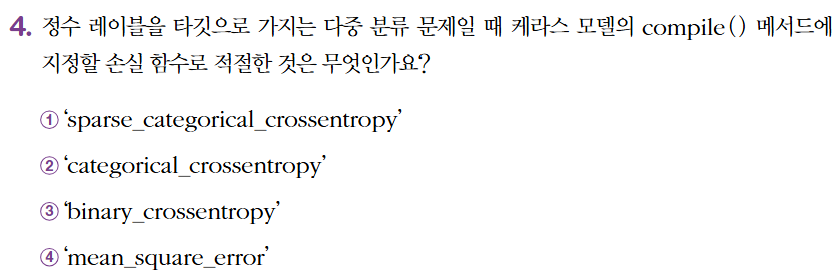

답: 1번

정수 레이블을 타깃으로 가지는 다중 분류 문제일 때는 sparse_categorical_crossentropy 손실함수를 사용한다.

추가 숙제(선택): Ch.07(07-2) 확인 문제(p.409~410) 풀고, 설명하기

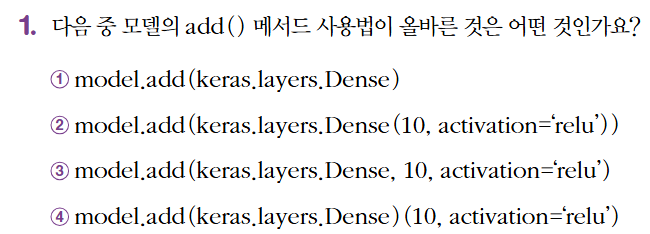

답: 2번

add() 메서드 안에 keras.layers.Dense() 형식으로 객체를 전달한다.

답: 2번

케라스 층으로 펼칠 때는 Flatten을 통해 펼칠 수 있다.

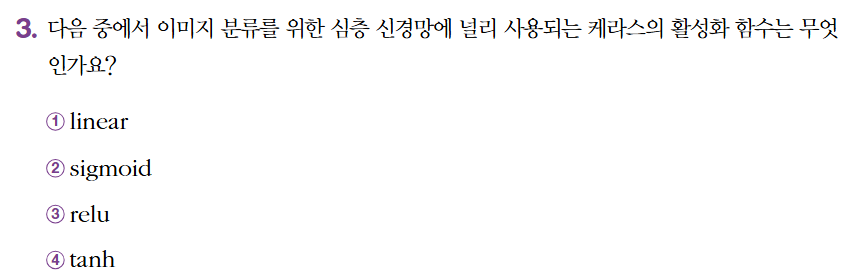

답: 3번

이미지 분류를 위한 심층 신경망에 널리 사용되는 케라스의 활성화 함수는 relu이다.

답: 1번

Adagrad, RMSprop, Adam 모두 적응적 학습률을 사용한다.

'데이터 분석 > 혼자 공부하는 머신러닝 + 딥러닝' 카테고리의 다른 글

| 5주차_비지도 학습 (1) | 2025.08.10 |

|---|---|

| 4주차_트리 알고리즘 (3) | 2025.07.27 |

| 3주차_다양한 분류 알고리즘 (0) | 2025.07.20 |

| 2주차_회귀 알고리즘과 모델 규제 (1) | 2025.07.12 |

| 1주차_나의 첫 머신러닝 및 데이터 다루기 (0) | 2025.07.05 |